收集必要推論資料

按資料政策收集 AI 系統的必要輸入、輸出與上下文,為評估提供資料基礎。

- 追蹤必要 Prompt 與回應內容

- 支援 Chatbot 與 Agent 工作流

- 基於真實或測試資料進行分析

從測試集、Ground Truth 到評分規則與人工覆核,建立可重複的 AI 回應品質評估流程。

按資料政策收集 AI 系統的必要輸入、輸出與上下文,為評估提供資料基礎。

建立標準化流程,對大量 AI 回應進行批量評估、比較與追蹤。

建立標準答案與測試資料,讓評估結果具備一致的比較基準。

針對不同指標對 AI 回應進行量化評分,協助分析模型與 Prompt 表現。

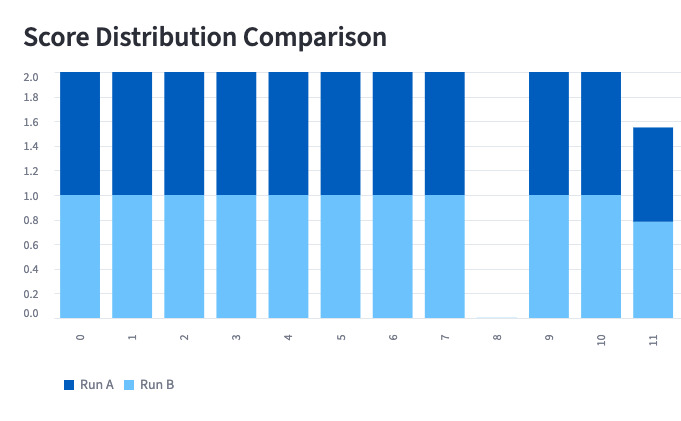

透過視覺化數據,追蹤模型表現、版本變化與異常案例。

可按企業要求選擇部署與資料處理方式,控制評估資料的存取與保存。

透過標準答案(Ground Truth)與批量評估機制,將 AI 回應轉化為可比較、可追蹤的數據,協助團隊持續優化模型表現。

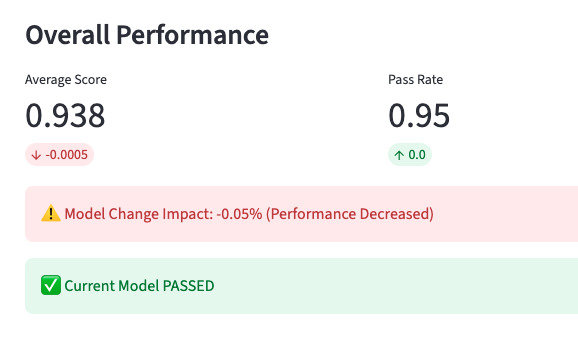

透過評估結果設定參考門檻,協助團隊判斷模型、Prompt 或系統變更是否需要調整、覆核或暫緩上線。

支援 AI 系統的開發、測試與部署,協助團隊建立上線判斷與改善依據

從資料收集、測試集到評分與覆核,建立可重複運行的 AI 品質評估流程

按資料政策記錄 AI 系統必要的輸入、輸出與上下文,作為評估的基礎資料。

將回應與 Ground Truth 或測試集進行比對,分析差異與偏差。

從準確性、相關性、一致性等指標進行評分,量化 AI 回應品質。

透過儀表板檢視結果,支援模型調整、Prompt 優化、人工覆核與部署判斷。

了解 AI 評估如何協助團隊建立品質比較、人工覆核與上線判斷依據